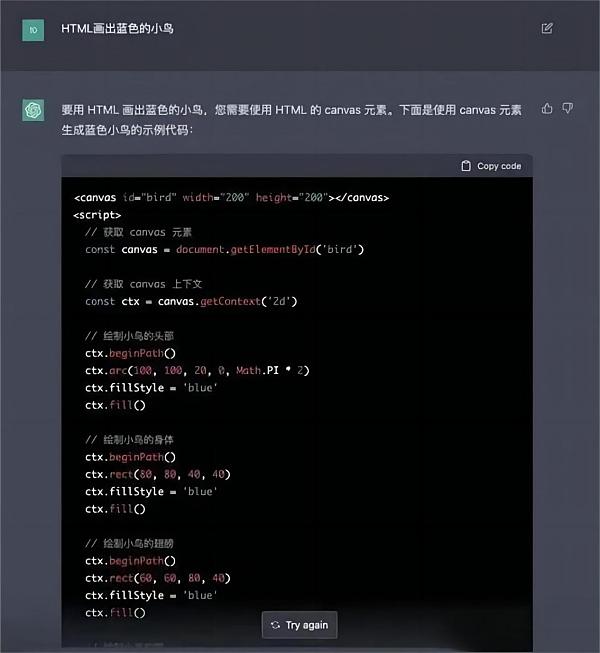

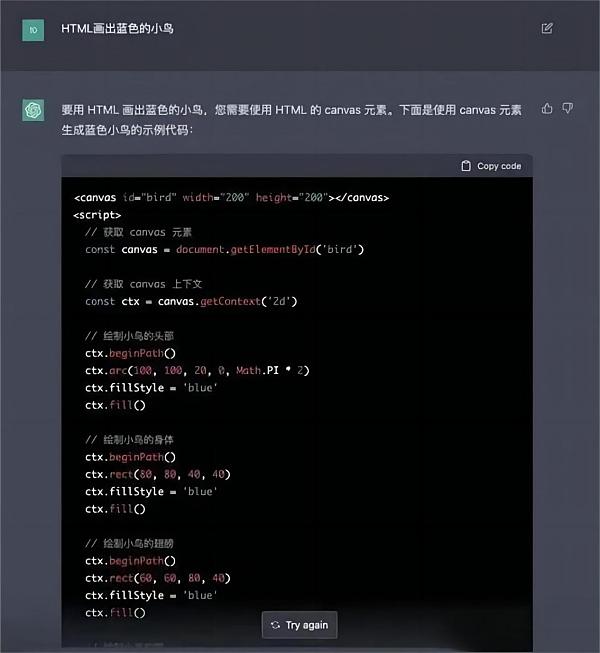

早在2014年徐可第一次創業時,她已經通過查看Openai代碼庫的方式,深刻地了解了這家公司,所以對于ChatGPT,徐可有著獨到的見解。徐可認為:“ChatGPT火爆背后是認知智能技術的一次飛躍,或將成為人工智能行業發展的里程碑和分水嶺。且ChatGPT有更多的商業價值和大行業前景,因為它能夠提供更多工作崗位和商業機會,例如輸入文本生成圖像、根據需求迅速寫出代碼、創造更成熟的文案等。”

Openai 代碼庫曾號稱永久開源,并且不會用于商業盈利。現在看來,Openai違背了他們的初心——核心代碼庫早在 2016年就停止了開源。且Elon Musk也曾是Openai的聯合創始人之一,但其與Openai管理層理念不合,在2019年退出了Openai公司,并在接管推特后終止了ChatGPT 和推特的學習連接。

雖然ChatGPT具備強大的學習能力,但由于其核心代碼目的不明確,這不禁會讓人聯想到霍金曾提到過的奇點降臨,“一旦人工智能跨過了與人類智慧相同的“奇點”( Singular Point ),我們可能會面臨“智慧爆炸”(intelligence explosion),屆時,人工智能在智慧上超越人類。這對人類產生的影響,要么就是最好的,要么就是最糟糕的。它既可能讓人類永生,也可能讓人類毀滅”。

徐可認為:“ChatGPT在受到熱議的同時,也遭到一些質疑,比如Eloquent、能言善辯、夸夸其談等。正是因為這些特性,當奇點降臨時,AI可能不會第一時間通過戰爭的形式打擊人類,而是在社交媒體散布虛假、恐怖信息等方式引起人類的恐慌和社會秩序的混亂。”

正因如此,徐可補充說:“AI的治理迫在眉睫,且我們需要重點關注兩個方面:

第一,控制AI的自我編譯能力。一旦奇點降臨,AI掌握了自我編譯能力,就意味著AI將突破人類對其的限制,這會導致計算機軟硬件可以自動演進、爆發式成長等,屆時,AI將徹底失控。

第二,篩選AI學習的信息源。如果AI學習的信息源過于反人類,這會導致社交媒體上有過多的反人類信息被傳播,會對認知較低的人群產生毀滅性的危害。如果再被利用到人類的派系斗爭中,AI極有可能被培養成戰爭機器。”

嘉賓提問:未來如何區分人類和AI?

徐可認為:“或許可以通過與去中心化社交結合的方式來解決。就熱門的Nostr協議來說,由于使用的是公私鑰體系、Client和Relay完成社交的去中心化,如果添加一個去中心化錢包,即可區分出人類與AI的區別。因為AI只能擁有公私鑰,且無法持有有價值的Token,這一方法可以在一定范圍內避免AI的危言聳聽,同時也可以參考這個思路,創造出更多的AI治理模式。”

NVIDIA官網探秘:顯卡、驅動與游戲技術的新篇章-深入解析NVIDIA官網:最新顯卡技術、驅動更新與游戲優化

NVIDIA官網探秘:顯卡、驅動與游戲技術的新篇章-深入解析NVIDIA官網:最新顯卡技術、驅動更新與游戲優化 大金空調除濕功能詳解:標志含義與使用指南-大金空調除濕標志:了解含義,掌握使用技巧

大金空調除濕功能詳解:標志含義與使用指南-大金空調除濕標志:了解含義,掌握使用技巧 智能變電站巡檢:機器人的角色與未來-變電站巡檢機器人的技術創新與應用發展

智能變電站巡檢:機器人的角色與未來-變電站巡檢機器人的技術創新與應用發展 高鐵上大學生幫了11歲時的自己-5月6日上午熱點新聞

高鐵上大學生幫了11歲時的自己-5月6日上午熱點新聞 網購迪士尼套餐最終民警護送入園-網購迪士尼套餐最終民警護送入園,女子稱遭網店欺詐威脅

網購迪士尼套餐最終民警護送入園-網購迪士尼套餐最終民警護送入園,女子稱遭網店欺詐威脅 原來上班真的能跨越階級-上班就能跨越階級!從一無所有到一毛不拔~

原來上班真的能跨越階級-上班就能跨越階級!從一無所有到一毛不拔~ 《八項注意三大紀律》的深刻內涵與當代價值-解讀《八項注意三大紀律》的歷史背景與現實意義

《八項注意三大紀律》的深刻內涵與當代價值-解讀《八項注意三大紀律》的歷史背景與現實意義 OPPO在線客服:一站式服務解決方案-了解OPPO在線客服的重要性及其優質服務

OPPO在線客服:一站式服務解決方案-了解OPPO在線客服的重要性及其優質服務